Inteligência física desperta debate sobre governança de sistemas autônomos

A governança da inteligência artificial aplicada ao mundo físico está se tornando um dos desafios mais urgentes da indústria de tecnologia. Conforme sistemas autônomos migram de ambientes puramente digitais para robôs, sensores e equipamentos industriais, a discussão central deixou de ser apenas se os agentes de inteligência artificial são capazes de executar tarefas para abordar como suas ações são testadas, monitoradas e interrompidas quando interagem com sistemas do mundo real. Essa transição coloca em cheque os mecanismos de controle que até então funcionavam em software e passam a operar em contextos onde erros podem ter consequências físicas imediatas.

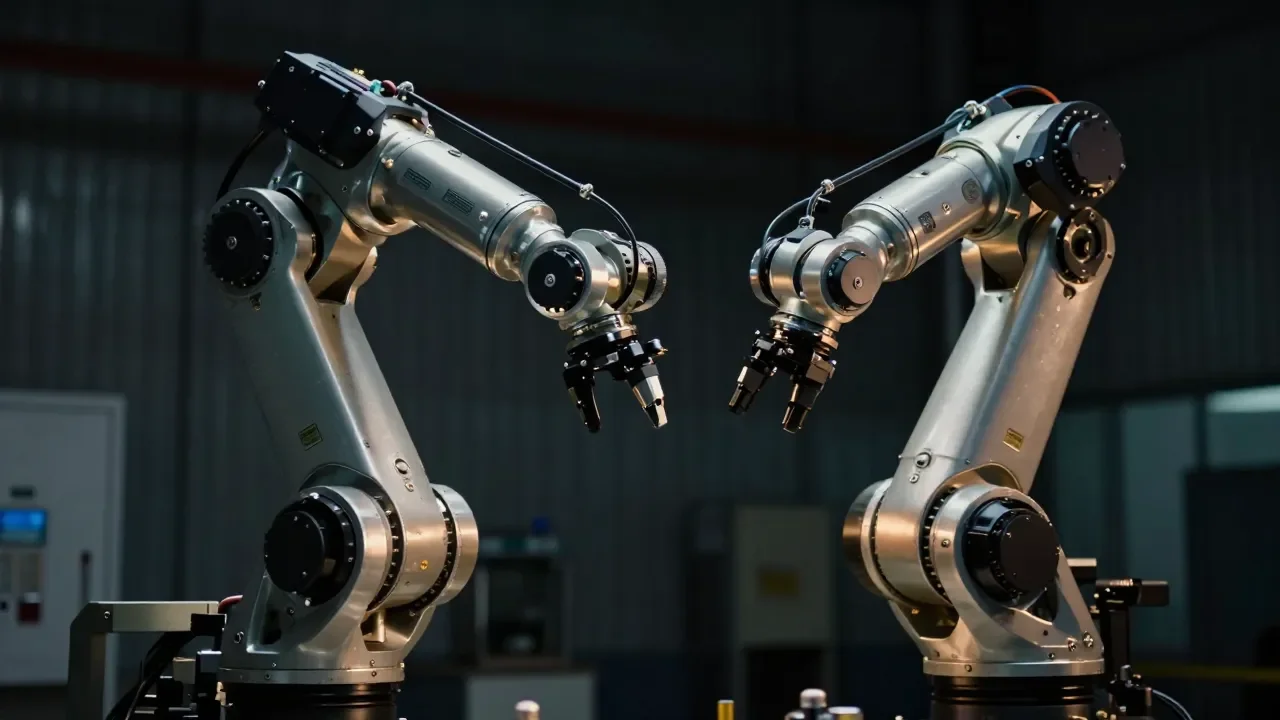

A robótica industrial oferece um panorama concreto dessa expansão. Segundo a Federação Internacional de Robótica, foram instalados 542 mil robôs industriais em todo o mundo em 2024, um número mais que o dobro do registrado uma década atrás. A entidade projeta que as instalações atinjam 575 mil unidades em 2025 e ultrapassem 700 mil até 2028. Esse crescimento acelerado eleva a pressão sobre as organizações para que estabeleçam regras claras de supervisão, já que cada máquina conectada a um modelo de inteligência artificial representa um ponto adicional de risco que precisa ser gerido.

Pesquisadores de mercado também estão expandindo a definição do que chamam de inteligência física para englobar um conjunto mais amplo de sistemas, incluindo robótica, computação de borda e máquinas autônomas. A consultoria Grand View Research estimou o mercado global de inteligência física em 81,64 bilhões de dólares em 2025, com projeção de atingir 960,38 bilhões de dólares até 2033. A categoria, porém, varia conforme cada fornecedor define o que constitui inteligência em sistemas físicos, o que torna ainda mais complexa a tarefa de criar padrões uniformes de governança.

A diferença fundamental em relação à automação de software é que sistemas físicos operam ao redor de ambientes de trabalho, infraestruturas e pessoas. Eles podem estar conectados a equipamentos que exigem limites de segurança rigorosos. A saída de um modelo de inteligência artificial, que antes se limitava a texto ou código, pode se transformar em um movimento de robô, uma instrução de máquina ou uma decisão baseada em dados de sensores. Por isso, limites de segurança e caminhos de escalonamento passam a fazer parte obrigatória do design do sistema, não algo que pode ser adicionado depois.

O trabalho de robótica do Google DeepMind ilustra como os modelos de inteligência artificial estão sendo adaptados para esse cenário. Em março de 2025, a empresa apresentou o Gemini Robotics e o Gemini Robotics-ER, modelos construídos sobre a base do Gemini 2.0 para robótica e inteligência corporificada, conceito que se refere a sistemas que percebem e agem em ambientes físicos. O Gemini Robotics é um modelo de visão, linguagem e ação projetado para controlar robôs diretamente, enquanto o Gemini Robotics-ER se concentra em raciocínio corporificado, incluindo compreensão espacial e planejamento de tarefas.

Um robô que utiliza esse tipo de modelo precisa identificar um objeto, compreender uma instrução e planejar uma sequência de movimentos. Além disso, é necessário avaliar se a tarefa foi concluída corretamente, o que cria um problema de controle que envolve tanto o comportamento do modelo quanto os limites mecânicos do sistema. O Google DeepMind definiu três requisitos para robôs úteis: generalidade, que cobre objetos e ambientes desconhecidos; interatividade, relacionada a entradas humanas e condições variáveis; e destreza, que se refere a tarefas físicas que exigem movimentos precisos.

Em seus materiais de lançamento, o Google DeepMind afirmou que o Gemini Robotics poderia seguir instruções em linguagem natural e realizar tarefas de manipulação em várias etapas. Os exemplos incluíam dobrar papel, embalar itens em uma bolsa e manipular objetos que não haviam sido vistos durante o período de treinamento, ou seja, o processo em que o sistema aprende padrões a partir de dados. Essa capacidade de generalização representa um avanço significativo, mas também amplia a superfície de possíveis falhas que precisam ser antecipadas e controladas.

Os requisitos técnicos para a inteligência física vão além da compreensão de linguagem. Os sistemas precisam de percepção visual, raciocínio espacial, planejamento de tarefas e detecção de sucesso. Na robótica, a detecção de sucesso é especialmente relevante porque o sistema deve decidir se uma tarefa foi concluída, se deve tentar novamente ou se deve parar. Essa decisão não pode depender apenas do modelo, mas precisa ser validada por mecanismos de segurança incorporados à arquitetura do sistema.

Em abril de 2026, o Google DeepMind introduziu o Gemini Robotics-ER 1.6, demonstrando como essas funções estão sendo consolidadas em versões mais recentes. A empresa descreve o modelo como apto a apoiar lógica espacial, planejamento de tarefas e detecção de sucesso, com a capacidade de raciocinar por meio de etapas intermediárias e decidir se deve avançar ou recomeçar. O modelo está disponível em fase preliminar por meio da interface de programação de aplicativos do Gemini, e é descrito como um modelo de visão e linguagem que leva as capacidades agenticas do Gemini para a robótica. O termo agentic se refere à capacidade de um sistema de atuar de forma autônoma para atingir objetivos, e essas capacidades incluem interpretação visual, raciocínio espacial e planejamento a partir de comandos em linguagem natural.

A governança se torna mais complexa quando esses sistemas podem chamar ferramentas, gerar código ou acionar ações físicas. Os controles precisam definir quais dados o sistema pode acessar, quais ferramentas pode utilizar, quais ações exigem aprovação humana e como a atividade é registrada para revisão posterior. Essa camada de supervisão, que já é desafiadora em ambientes de software, ganha uma dimensão completamente nova quando o resultado de uma decisão do modelo pode se traduzir em movimento mecânico ou na operação de um equipamento industrial.

A pesquisa de confiança em inteligência artificial publicada pela McKinsey em 2026 aponta para a mesma questão de forma mais ampla. O levantamento revelou que apenas cerca de um terço das organizações pesquisadas reportaram níveis de maturidade três ou superiores em estratégia, governança e governança de inteligência artificial agentic, mesmo enquanto esses sistemas assumem funções cada vez mais autônomas. Esse dado sugere que a maioria das empresas ainda está em fases iniciais de estruturação de controles adequados para lidar com sistemas que operam com relativa independência.

Na robótica, a segurança também abrange o comportamento físico da máquina. O Google DeepMind descreveu a segurança de robôs como um problema em camadas, que inclui controles de nível inferior, como prevenção de colisões, limites de força e estabilidade, além de raciocínio de nível superior sobre se uma ação solicitada é segura no contexto. Essa abordagem em camadas significa que não basta um único mecanismo de proteção, sendo necessário um conjunto coordenado de barreiras técnicas e processuais.

A empresa também apresentou o ASIMOV, um conjunto de dados criado para avaliar a segurança semântica em robótica e inteligência corporificada. O objetivo do material é testar se os sistemas são capazes de compreender instruções relacionadas à segurança e evitar comportamentos inseguros em ambientes físicos. Conjuntos de dados desse tipo são fundamentais porque permitem que pesquisadores e desenvolvedores avaliem os modelos em cenários controlados antes de implantá-los em operações reais.

Os mesmos controles utilizados para agentes de software, como direitos de acesso, trilhas de auditoria e comportamento de recusa, tornam-se mais difíceis de gerenciar quando os sistemas estão conectados a robôs, sensores ou equipamentos industriais. Frameworks de governança, como o Quadro de Gerenciamento de Riscos de Inteligência Artificial do NIST e a norma ISO/IEC 42001, oferecem estruturas para o gerenciamento de riscos e responsabilidades ao longo do ciclo de vida do sistema. No contexto da inteligência física, esses controles precisam considerar o comportamento do modelo, as máquinas conectadas e o ambiente de operação.

O Google DeepMind também tem colaborado com empresas de robótica no desenvolvimento de sua inteligência corporificada. Em março de 2025, a empresa informou que estava em parceria com a Apptronik no desenvolvimento de robôs humanoides utilizando o Gemini 2.0, e listou a Agile Robots, a Agility Robotics, a Boston Dynamics e a Enchanted Tools como parceiras testadoras do Gemini Robotics-ER. A atualização de 2026 mencionou também o trabalho com a Boston Dynamics em tarefas como leitura de instrumentos, um caso de uso que depende de compreensão visual, planejamento de tarefas e avaliação confiável de condições físicas.

A inteligência física se aplica a áreas como inspeção industrial, manufatura, logística, instalações e armazéns. Esses ambientes exigem sistemas capazes de interpretar condições do mundo real e agir dentro de limites predefinidos. A questão central de governança é como esses limites são estabelecidos antes que sistemas autônomos sejam autorizados a tomar ou executar decisões, um debate que tende a se intensificar na medida em que mais modelos de inteligência artificial forem incorporados a máquinas e equipamentos no dia a dia da indústria.